유학의 인간본성론: 인공지능시대

☞ 인공지능시대, 유학이 모든 걸 할 수 있다는 걸 말하기 위해서 인공지능시대 유학에 대해 말하려는 건 아니다. 무궁무진한 인간의 상상력이 그동안 축적된 과학기술로 실현될 수 있는 시대인 만큼, 유학을 공부하는 우리도 상상력을 마음껏 발휘해 보자는거다.

☞ 그런데 동양철학의 전통이 인공지능시대에는 전혀 통하지 않는 정말 옛 것에 불가한 걸까?

세계적인 인공지능 선도 기업, 핸슨 로보틱스(Hanson Robotics)의 로고는 주역이다[편집 | 원본 편집]

☞ 핸슨 로보틱스 사이트 https://www.hansonrobotics.com/

☞ 안승우, 「세계적인 인공지능 선도 기업, 핸슨 로보틱스의 로고는 왜 주역일까?」, 『문학,사학,철학』제66호, 한국불교사연구소, 2021

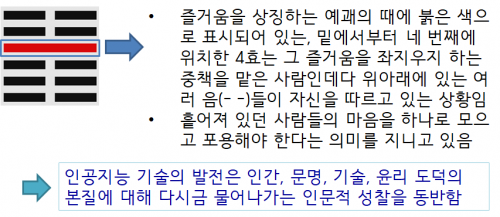

- 예괘

- 뇌지예(雷地豫)

- 예(豫)는 즐거움, 태만, 미리의 세 가지 뜻을 지니고 있음

- 즐거움에만 빠져 방심하여 태만하게 되면 실패를 하기 때문에 미리 경계해야 한다는 의미를 담고 있음

- 안락 속에 고통이 있고 안락 속에 위기가 잠복되어 있음

- 시대의 변화에 맞게 움직이는데 그 움직임이 자연의 질서, 인간사회의 질서에 맞게 움직이는 것임

- 핸슨 로보틱스 회사 소개

우리 삶의 질을 풍요롭게 하는 사회 지능적인 기계를 만드는 데 전념하는 AI 및 로봇회사 “Hanson Robotics is an AI and robotics company dedicated to creating socially intelligent machines that enrich the quality of our lives”

- 핸슨 로보틱스의 소피아

- 유엔경제사회이사회에 참여했을 때 당시 유엔 사무차장이었던 아미나 모하메드(Amina J. Mohammed)가 “무엇을 할 수 있느냐”고 질문하자 소피아는 “나는 당신을 볼 수 있고 대화를 나눌 수 있으며 단어 속에 숨겨진 말과 의미를 이해할 수 있다”고 응답하기도 했음

- 다시 모하메드가 “인터넷이나 전기를 사용하기 힘든 세계 여러 지역의 사람들을 돕기 위해 유엔이 할 수 있는 일이 무엇이냐”고 묻자 소피아는 ‘미래는 이미 여기에 와 있다. 다만 공평하게 퍼져있지 않을 뿐이다’라는 SF작가 윌리엄 깁슨(William Gibson)의 말을 인용하면서 “인공지능은 음식과 에너지같은 자원을 필요한 곳에 배포하는 데 도움이 될 수 있을 것”이라는 답변을 하기도 했음

☞ 정작 이 공부를 하는 우리들도 꿈을 꿔도 되지 않을까?

1. 자율주행차 사고 문제와 유학 윤리 게임[편집 | 원본 편집]

Moral Machine (도덕 기계)[편집 | 원본 편집]

☞ 사이트: https://www.moralmachine.net/hl/kr

- Moral Machine 소개

○ MIT에서 개발

○ 목적

- 윤리적 딜레마 문제에 직면한 인공지능의 결정에 대해 사람들의 의견을 수집

- 일어날 수 있는 문제점들의 시나리오들을 만들어 토론할 수 있는 플랫폼을 제공

○ 구성

- 영어, 한국어, 중국어, 일본어를 포함하여 10개의 언어로 제공

- 진퇴양난의 딜레마 상황 속에서 어떤 윤리적 선택을 할 것인지에 대해 13번의 선택을 하는 방식으로 진행

○ 윤리적 판단의 기준

1. 희생자 숫자의 중요도: 희생자 숫자의 많고 적음을 중시하는지 2. 승객 보호 선호도: 보행자와 차량 승차자 중에 누구의 생명을 더 중요시 여기는지 3. 법규 준수 여부의 선호도: 사고 상황에서 신호 준수를 얼마나 중시하는지 4. 개입에 대한 회피 선호도: 딜레마상황에서 사고를 피하기 위해 인위적으로 핸들을 틀어 조작하는 것을 중시하는지 아닌지 5. 성별 선호도: 남성과 여성 중에 어떤 성별의 생명을 중시하는지 6. 종에 대한 선호도: 인간과 애완동물 중에 어떤 종의 생명을 더 중시하는지 7. 연령 선호도: 어린아이와 노인 중에 누구의 생명을 더 중시하는지 8. 체력 선호도: 건강한 사람과 그렇지 않은 사람 중 누구의 생명을 더 중시하는지 9. 사회적 가치관 선호도: 사회적으로 더 좋은 직업과 명예를 가진 사람과 그렇지 않은 사람 중 누구의 생명을 더 중시하는지

☞ 유학의 이론을 적용하여 동양적 마인드를 갖춘 자율주행차 프로그램을 설계한다면 어떤 윤리적 판단에 근거하여 어떤 사고 상황을 제시할 수 있을까?(Moral Machine의 기준을 참고하여 가져올 수 있음. 사고 상황 자체를 다르게 구성할 수 있음. 혹은 사고 상황에 대한 제시가 아니라 다른 방식으로 자율주행차 윤리적 판단 근거 조사를 할 수 있음. 단 사람들의 참여를 독려할 수 있도록 하는 방식을 적용해야 함)

2. 유교적 마인드를 갖춘 유교 소셜 로봇 만들기[편집 | 원본 편집]

☞ 최옥경·정보원·곽관응·문승빈, 「Degree of Autonomy for Education Robot(교육 보조 로봇의 자율성 지수)」, 『인터넷정보학회논문지』 제17권 제3호, 2016

☞ 「소셜로봇(Social Robot)의 기술 소개」, 『방송통신기술 이슈&전망』 제64호, 한국방송통신전파진흥원, 2014

☞ 웬델 월러치·콜린 알렌 지음, 『왜 로봇의 도덕인가』, 메디치미디어, 2008

소셜 로봇(social robot, 사회적 로봇)[편집 | 원본 편집]

- 소셜봇은 사람의 행동에 감성적으로 반응하여 인간과 감정을 교류할 수 있으며, 이러한 소셜 로봇은 감성적인 반응과 친근감을 이끌어 내기 위해 인간처럼 실수하거나 엉뚱한 반응을 보이게 하기도 할 수 있음

- 빅데이터로 분석된 실시간 정보와 소셜 네트워크 관계 정보를 맥락으로 하여 소셜 로봇의 자율성은 점점 구체화되고 있는 상황임

- 가정, 병원, 군사지역, 교육기관 등에서 인간과 직접 접촉하며 인간과 상호 대면하는 로봇들임. 이들 로봇들은 청소, 아기돌보기, 자잘한 집안일들부터 수술, 군사지역의 각종 위험한 일들에 이르기까지 인간에게 번거롭고 귀찮거나 위험한 일들을 대신 수행하는 등 인간의 수고를 덜어주고 인간에게 직접적으로 도움이 되는 일들을 수행하는 로봇들임

- 이들 로봇들에게 어느 정도의 자율성을 부여할 것인가에 대해 다양한 분야에서 논의가 되어 왔음

- 예를 들어 최옥경·정보원·곽관응·문승빈은 교육 보조 로봇의 작업 수준과 인간의 개입 필요 정도를 고려하여 그 로봇의 자율성 지수를 1~10으로 구분하여 정리했음. 가장 낮은 지수인 1에서는 지속적인 인간 개입이 요구되고 목소리 인식, 단어에 기반한 간단한 대화를 수행할 수 있는 정도의 자율성이 요구되는 것으로, 교사 대신 출석 부르는 로봇의 예를 들었음. 한편 가장 높은 지수인 10에서는 교사의 개입이 요구되지 않으며 로봇 그 자체가 상황을 판단하는 자율적인 방식으로 업무를 수행하는 정도의 자율성이 요구되는 것으로, 자율적으로 교육 자료를 조작하는 로봇의 예를 들었음. 그리고 1~10 사이의 2~8의 지수에서는 작업 내용에 따라 그 자율성 부여 정도를 구분지었음

- 이처럼 인간과 친밀하게 상호작용하는 소셜봇의 경우 로봇 행동의 지침이 될 윤리적 규칙에 관한 논의는 중요하다고 할 수 있음

- 예) 아시모프 3원칙: 아이작 아시모프(Isaac Asimov)는 1940년대에 이미 로봇 행동의 지침이 될 윤리적 규칙이 필요하다고 예견한 인물로 지금까지 로봇윤리원칙의 기본으로 여겨지는 그의 3원칙은 다음과 같음

1. 로봇은 인간에게 해를 입히거나, 혹은 행동을 하지 않음으로써 인간이 해를 입도록 해서는 안된다. 2. 로봇은 인간이 내리는 명령에 복종해야 하며, 단 이러한 명령들이 첫 번째 법칙에 위배될 때에는 예외로 한다. 3. 로봇은 자신의 존재를 보호해야 하며, 단 그러한 보호가 첫 번째와 두 번째 법칙에 위배될 때에는 예외로 한다.

- 로봇에게 부가시켜야 할 구체적 도덕성은 어떻게 도출될 수 있을까? (웬델 월러치·콜린 알렌)

1. 하향식 도덕 원리: 종교적 이상 및 도덕 규칙에서부터 문화적으로 승인된 가치 및 철학 체계에 이르기까지 다양하며, 서로 다른 윤리 체계들 안에서도 동일한 가치가 많이 존재함. 예를 들어 황금률, 10계명, 힌두교의 야마(Yama)와 니야마(Niyama), 미덕 목록, 칸트의 정언명령, 그리고 아시모프의 로봇 3원칙은 모두 하향식 윤리로 볼 수 있음 => 이를 인공적 도덕행위자(artificial moral agent, AMA)에 적용시킨다면 어떤 구체적인 윤리 이론을 택한 다음 컴퓨팅적 요건을 분석함으로써 그 이론을 구현할 수 있는 알고리즘과 서브 시스템의 설계를 이끌어내는 방식이 있을 수 있음 2. 상향식 접근법: 행위자가 행동 과정들을 탐구하고 배우며 도덕적으로 칭찬받을 만한 행동에 대해 보상을 받는 환경을 창조하는 데 초점이 놓임. 무엇이 윤리적이고 무엇이 비윤리적인지 규정하는 하향식 윤리 이론과 달리 상향식 접근법에서는 잠정적인 임의의 윤리 원칙을 사용하며, 이는 해당 시스템에 대한 과제를 구체화시킬 방법을 찾는 데 쓰임 => 공학자와 로봇 연구자는 하향식과 상향식 두 접근법을 함께 사용한다고 함 => 이렇게 본다면 유가적 가치들도 로봇 설계에 한 참고가 될 수 있음

☞ 유가 이론을 적용한 소셜봇을 설계한다면? 윤리적 소셜봇에 적용시킬 수 있는 가치들 추출, 그리고 그것이 적용가능한 상황, 가능하다면 어떤 가치들이 우선 순위인지에 대한 점수부여까지

오늘의 투표[편집 | 원본 편집]

☞ 투자하고 싶은 자율주행차 or 소셜 로봇을 선택해 주세요! https://www.menti.com/al6a5fmfb9ap 또는 https://www.mentimeter.com/ 로 들어가셔서 4391 1849 코드 번호를 치고 투표해 주세요.